更快更好的实时AI,英伟达TensorRT 8让时延与精度不纠结

2021-07-20 21:34:13AI云资讯911

性能精度均提升2倍

一直以来,英伟达在AI领域的布局都不止于硬件,TensorRT就是重要佐证之一,作为用于高性能深度学习推理的SDK。此SDK包含深度学习推理优化器和运行时环境,可为深度学习推理应用提供低延迟和高吞吐量。

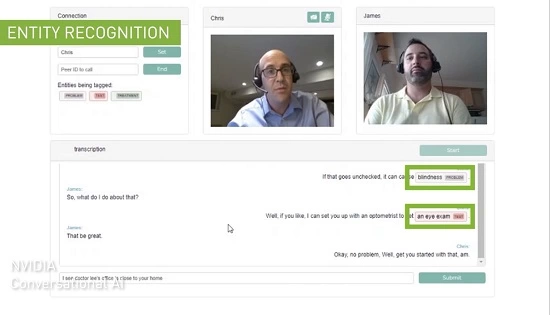

通过TensorRT,开发者可将TensorFlow、Pytorch等训练好的框架模型,通过优化后良好的运行在英伟达的GPU上。在2019年发布的NVIDIA TensorRT 7已经为智能的AI人际交互打开了大门,可实现与语音代理、聊天机器人和推荐引擎等应用的实时互动。

TensorRT 7配合A100 GPU可实现在2.5毫秒内运行BERT-Large,此次新发布的TensorRT 8将时间缩减至1.2毫秒。作为目前最广为采用的基于transformer的模型之一,意味着理论上当用户在使用如实时语音翻译这样的功能时,TensorRT 8的处理延迟时间可降至1.2毫秒。

TensorRT 8相比TensorRT 7有着两倍性能提升的同时,精度也同样提升2倍。TensorRT 8在两方面实现了AI推理上的突破,一方面提升了对于英伟达Ampere架构GPU的稀疏性,在提升效率的同时还能减少开发者加速神经网络时的计算操作。另一方面是量化感知训练,开发者能够使用训练好的模型,以INT8精度运行推理,在这一过程中不会损失精度。

这就意味着,企业可以将模型扩大1-2倍,实现精度的大幅提升,让自身的实时AI应用变得又快又好。

为多领域带来更快更好的AI能力

当前,TensorRT的生态影响力正在快速增长,2020年的开发者人数相比2019年就实现了3倍的增长,达到35万人,下载量已经达到近250万次,共有从边缘到云的多个领域的共27500家公司加入到该生态之中。其中包括如电信运营商Verizon,也有国内的知名互联网公司阿里、腾讯、字节跳动等。

TensorRT 8的发布无疑将会让搜索、购物推荐、语音翻译、语音转文字这样的AI应用能够实现更快更好。Hugging Face就正在与英伟达开展密切合作,作为大规模AI服务提供商,Hugging Face加速推理API能够为基于NVIDIA GPU的transformer模型提供高达100倍的速度提升,通过TensorRT 8,Hugging Face在BERT上实现了1毫秒的推理延迟,为助力实现大规模文本分析、神经搜索和对话式应用的AI服务提供加速度。

据悉,TensorRT目前还应用在了临床医疗领域,GE医疗就通过TensorRT来助力加速超声波计算机视觉应用,这是一款早期检测疾病的关键工具。TensorRT的实时推理能力提高了视图检测算法的性能,缩短了产品上市时间。实际工作中可让扫描仪在进行自动心脏视图检测时更高效,心脏视图识别算法会选择合适的图像来分析心壁运动。

TensorRT8无疑将让反应更快更聪明的客服机器人、实时翻译更迅速的应用变得可以翘首以待,也许能够随时接话茬的将不止是调皮的学生,机器人也可以做到。人与人之间的交流,语音上的牵绊变得更低,翻译可以同语音实时同步,即时记录成文字也不成问题,准确性也十分不错。更快更好的实时AI正在到来。

相关文章

- 英伟达发布RTX Spark芯片,高调杀入PC市场

- 维谛(Vertiv)将在COMPUTEX展示首个面向英伟达NVIDIA Omniverse DSX Blueprint的全融合物理基础设施数字孪生能力

- AI驱动量子计算风口已至!英伟达/微美全息抢占高地锁定量子生态席位!

- 英伟达首席财务官调侃竞争对手因存储芯片短缺措手不及

- SpaceXAI宣布将向Anthropic开放搭载22万张英伟达GPU的巨像一号超级计算机

- OpenAI宣布与AMD、英伟达、英特尔、微软及博通达成超级合作,合力加速AI发展

- Anthropic看中英国初创公司融合技术,以仅英伟达Groq十分之一的成本,实现百倍速度的AI推理

- 英伟达发布开源AI模型Neomotron 3 Nano Omni,性能提升高达9倍

- 英伟达Rubin芯片落地谷歌A5X实例,多站点集群规模扩展至近百万颗GPU

- Meta携手博通强化芯片合作,英伟达/微美全息AI千亿赛道“抢滩战”打响!

- 从相干光量子计算机到开源AI模型,玻色量子与英伟达向百年伊辛模型的共同致敬

- 英伟达AI智能工厂宏图再掀热潮!特斯拉/微美全息自研芯片加固AI云计算护城河!

- 英伟达的真正实力在于基础设施,但投资融合的掌控力也不容忽视

- 美光为英伟达Vera Rubin平台量产36GB HBM4、28Gbps PCIe Gen6固态硬盘及192GB SOCAMM2内存

- 英伟达发布新一代超分辨率技术DLSS 5:神经渲染加持,颠覆性视觉提升

- 英伟达:将与比亚迪、吉利进行自动驾驶出租车业务合作

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源