OpenClaw 本地化部署更优解:KunTai W916 以硬核算力底座,赋能开源 AI 智能体安全落地

2026-03-11 11:52:36AI云资讯1674

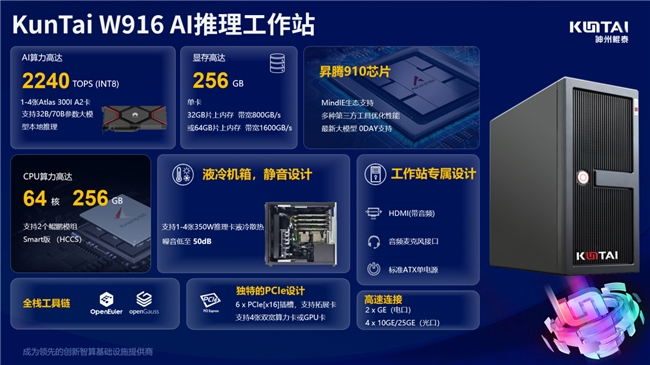

当OpenClaw作为现象级开源AI智能体,正以“本地执行、自主进化、多场景适配”的核心优势席卷而来,但其本地化部署对硬件底座的算力支撑、稳定性与适配性提出了更高要求。神州鲲泰KunTai W916 AI推理工作站,作为基于华为“鲲鹏+昇腾”技术路线打造的边端高性能算力平台,凭借其定制化的硬件架构、卓越的推理效能与广泛的场景适配能力,成为OpenClaw本地化部署的更优硬件搭档,既破解了开源AI智能体本地化部署中的算力瓶颈,又充分释放了其“会干活、能进化、高安全”的核心价值,让AI智能体从“技术概念”落地为千行百业的实用工具。

OpenClaw 打破传统 AI“只对话、不执行” 局限,依托本地私有化部署实现自然语言指令到系统操作的闭环,可完成文件管理、代码调试等多元任务,被称为“24 小时待命的数字员工”。但其递归式技能进化、多模型适配及本地数据处理需求,在本地化部署场景下,对硬件算力、兼容性与稳定性提出严苛考验,普通 PC 与小型服务器均难以满足。神州鲲泰 KunTai W916 AI 推理工作站精准匹配其部署需求,以四大核心优势筑牢开源 AI 智能体落地的硬件底座。

算力精准适配,解锁高效执行潜能

作为本地大模型推理高性能边端平台,KunTai W916 搭载华为鲲鹏处理器与昇腾 AI 芯片,构建 “CPU+AI 加速” 协同算力架构,既具备强大多核并行处理能力,又能通过昇腾芯片硬件加速,大幅提升 OpenClaw 推理与任务执行速度。可轻松承载其全场景运行需求,支持多任务并行处理,彻底解决普通硬件本地化部署 “算力不足、响应迟缓” 的痛点。同时,围绕 DeepSeek、Qwen 等主流大模型打造软件矩阵,灵活对接各类模型,充分发挥 OpenClaw 开源生态优势。

场景灵活适配,打通落地最后一公里

OpenClaw 覆盖企业办公、开发者调试、政务、交通、医疗等多场景,要求硬件具备小型化、易部署、强环境适应性特点。KunTai W916 采用塔式机箱设计,体积紧凑,且具备高静音工艺,可放置于办公室、政务大厅等各类场景,无需专用机房,开箱即部署。相较同级别产品,其算力更强,可避免任务中断与功能受限,且能在不同温湿度环境下稳定运行,适配边端实时数据处理、隐私数据处理等多样化需求,实现“边端算力下沉”及应用场景拓展。

安全可靠兜底,守护本地部署隐私

OpenClaw本地私有化部署的核心优势是数据隐私可控,这要求硬件具备完善安全防护与高稳定性。KunTai W916 基于“鲲鹏 + 昇腾”技术路线打造,从底层硬件架构确保了系统的内生安全,结合本地私有化部署,最大程度规避了云端泄露的风险,契合金融、政务等高安全需求行业场景。经严格稳定性测试,支持7×24 小时不间断运行,避免任务中断。同时支持本地数据加密存储,进一步强化隐私保护,解决开源 AI 智能体部署“稳定性不足、安全无保障”的痛点。

高效易用赋能,降低部署运维成本

OpenClaw的开源特性对部署运维专业性有一定要求,而 KunTai W916 通过硬件优化大幅降低门槛。其为紧凑型算力一体机,集成算力、存储、网络等全要素,无需额外硬件,用户可快速完成安装部署,无需专业运维团队。同时具备良好扩展性,可根据功能升级与场景需求灵活扩展配置,适配插件拓展与版本升级,延长设备寿命,降低企业硬件投入成本。相较传统服务器,其运维更便捷、成本更低,适配极客自定义开发与企业快速落地需求。

在 AI 智能体从实验室走向实用化的浪潮中,硬件底座决定软件价值释放。神州鲲泰 KunTai W916 与 OpenClaw 的适配,构建“开源软件 + 自主硬件”协同生态,为本地化部署提供最优解。未来,KunTai W916 将持续迭代优化,依托 “鲲鹏 + 昇腾” 技术路线提升算力、场景适配与安全能力,为 OpenClaw 等开源 AI 智能体提供更强支撑,助力千行百业数字化转型,解锁 AI 应用新可能。

相关文章

- 保姆级 NAS docker 部署 Openclaw 并接入飞书,海康教程

- 实现”养虾”自由.打造全能AI助理!龙虾OpenClaw(原Clawdbot)完美接入智增增API配置指南

- Aginode安捷诺:OpenClaw开启的智能体浪潮,如何重塑下一代智算网络?

- 微软为Copilot测试类似OpenClaw的AI机器人

- 从Agent 浪潮到组织变革,腾讯云携手业界专家共探OpenClaw时代的安全边界与企业进化

- 破解Agent场景落地难题!拓维信息旗下湘江鲲鹏重磅推出OpenClaw部署新范式

- OpenClaw×全屋智能,博联解锁智慧生活新范式

- 行业首发!像素蛋糕正式接入OpenClaw,再次引领行业迈向Agent时代

- 百度智能云联合Founder Park举办AI硬件淘金局,聚焦OpenClaw驱动下的产业新机遇

- 爆火出圈!12 城奔赴,9万人线上围观,极客邦科技OpenClaw 中国行圆满落幕

- 浙江大学CCAI宁波中心OpenClaw企业智能体实战训练营在宁波顺利举办

- 百度网盘GenFlow全新升级,融合OpenClaw,支持多人AI协作

- 拥抱赋能OpenClaw智能生态,此芯科技CIX ClawCore螯芯系列芯片震撼首发

- 这家公司“手搓”了一套低空领域的“OpenClaw”? 解密从“遥控能飞”到“可控智飞”的ARC OS系统

- 从“百城送龙虾”到“龙虾全家桶”,百度智能云推动OpenClaw走向产业落地

- 内核级能力加持!国产操作系统为OpenClaw打造安全“隔离舱”

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源

- 百度千帆深度研究Agent登顶权威评测榜单DeepResearch Bench

- 在MoltBot/ClawdBot,火山方舟模型服务助力开发者畅享模型自由