OpenAI和DeepMind AI系统在Pong和Enduro实现了“超人”的表现

2018-11-22 09:50:56AI云资讯1253

通过观看人类来玩游戏的机器学习可能听起来像科幻小说的情节,但这正是OpenAI的研究人员以及谷歌子公司DeepMind声称已经完成了。 OpenAI这是一个由Elon Musk,Reid Hoffman和Peter Thiel支持的非营利性,总部位于旧金山的人工智能研究公司。

该研究已提交给神经信息处理系统(NIPS 2018),该系统计划于12月的第一周在加拿大蒙特利尔举行。

“为了通过强化学习解决复杂的现实问题,我们不能依赖手动指定的奖励功能,”该团队写道。“相反,我们可以让人类直接向代理人传达目标。”

这是一种在先前的研究中被称为“逆强化学习”的技术,它对于涉及定义不明确的目标的任务有希望,这些目标往往会绊倒人工智能(AI)系统。正如该论文的作者所指出的那样,强化学习 - 使用奖励(或惩罚)系统来驱动AI代理人实现特定目标 - 如果所讨论的目标缺乏反馈机制,则没有多大用处。

由研究人员的AI模型创建的游戏代理不仅模仿人类行为。如果他们有,他们就不会具有特别的可扩展性,因为他们需要一个人类专家来教他们如何执行特定任务,而且永远不会能够比所述专家实现“显着”更好的性能。

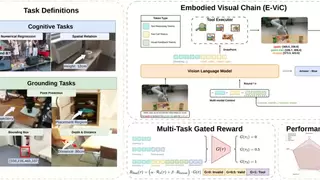

研究人员的系统结合了多种形式的反馈,包括来自专家演示的模仿学习和使用轨迹偏好的奖励模型。基本上,它没有假设直接可用的奖励,例如分数增加或游戏内奖金;相反,依靠循环中人类的反馈,它试图通过(1)模仿示范和(2)最大化推断的奖励函数来尽可能接近预期的行为。

该模型由两部分组成:深度Q-Learning网络,DeepMind在先前的研究中用于实现Atari 2600游戏中的超人表现,以及奖励模型,一种卷积神经网络,由注释器提供的标签训练 - 无论是人还是合成系统 - 在任务培训期间。

代理人随着时间的推移从示威和经验中学到了知识。人类专家一直阻止他们利用可能损害绩效的意外奖励来源,这种现象称为奖励黑客。

在测试中,研究人员在Arcade学习环境中设置AI模型的代理,这是一个开源框架,用于设计可以玩Atari 2600游戏的AI代理。研究人员写道,Atari游戏具有“强化学习中最多样化的环境”的优势,并提供“明确的”奖励功能。

经过5000万步骤和6,800个标签的完整时间表,受过研究人员系统训练的代理人在所有测试的游戏中都超越了模拟学习基线,除了私人眼睛(包括Beamrider,Breakout,Enduro,Pong,Q * bert和Seaquest)。研究人员发现,人类示威活动使Hero,Montezuma's Revenge和Private Eye受益匪浅,并且通常将实现相同性能水平所需的人工时间减半。

这项研究紧随人工智能系统 - 也是OpenAI科学家的工作 - 在Montezuma的复仇中可以成为最佳人类。(该模型的大多数性能改进来自随机网络蒸馏,它引入了奖励奖励,该奖励基于预测下一个状态下固定和随机初始化神经网络的输出。)当在超级马里奥上设置松散时,由系统训练的代理发现了11个关卡,找到了秘密房间,并击败了老板。当他们在Pong与一名人类球员一起打球时,他们试图延长比赛而不是赢球。

6月份OpenAI开发的机器人可能会击败Valve的Dota 2中的技术团队。

该研究已提交给神经信息处理系统(NIPS 2018),该系统计划于12月的第一周在加拿大蒙特利尔举行。

“为了通过强化学习解决复杂的现实问题,我们不能依赖手动指定的奖励功能,”该团队写道。“相反,我们可以让人类直接向代理人传达目标。”

这是一种在先前的研究中被称为“逆强化学习”的技术,它对于涉及定义不明确的目标的任务有希望,这些目标往往会绊倒人工智能(AI)系统。正如该论文的作者所指出的那样,强化学习 - 使用奖励(或惩罚)系统来驱动AI代理人实现特定目标 - 如果所讨论的目标缺乏反馈机制,则没有多大用处。

由研究人员的AI模型创建的游戏代理不仅模仿人类行为。如果他们有,他们就不会具有特别的可扩展性,因为他们需要一个人类专家来教他们如何执行特定任务,而且永远不会能够比所述专家实现“显着”更好的性能。

研究人员的系统结合了多种形式的反馈,包括来自专家演示的模仿学习和使用轨迹偏好的奖励模型。基本上,它没有假设直接可用的奖励,例如分数增加或游戏内奖金;相反,依靠循环中人类的反馈,它试图通过(1)模仿示范和(2)最大化推断的奖励函数来尽可能接近预期的行为。

该模型由两部分组成:深度Q-Learning网络,DeepMind在先前的研究中用于实现Atari 2600游戏中的超人表现,以及奖励模型,一种卷积神经网络,由注释器提供的标签训练 - 无论是人还是合成系统 - 在任务培训期间。

代理人随着时间的推移从示威和经验中学到了知识。人类专家一直阻止他们利用可能损害绩效的意外奖励来源,这种现象称为奖励黑客。

在测试中,研究人员在Arcade学习环境中设置AI模型的代理,这是一个开源框架,用于设计可以玩Atari 2600游戏的AI代理。研究人员写道,Atari游戏具有“强化学习中最多样化的环境”的优势,并提供“明确的”奖励功能。

经过5000万步骤和6,800个标签的完整时间表,受过研究人员系统训练的代理人在所有测试的游戏中都超越了模拟学习基线,除了私人眼睛(包括Beamrider,Breakout,Enduro,Pong,Q * bert和Seaquest)。研究人员发现,人类示威活动使Hero,Montezuma's Revenge和Private Eye受益匪浅,并且通常将实现相同性能水平所需的人工时间减半。

这项研究紧随人工智能系统 - 也是OpenAI科学家的工作 - 在Montezuma的复仇中可以成为最佳人类。(该模型的大多数性能改进来自随机网络蒸馏,它引入了奖励奖励,该奖励基于预测下一个状态下固定和随机初始化神经网络的输出。)当在超级马里奥上设置松散时,由系统训练的代理发现了11个关卡,找到了秘密房间,并击败了老板。当他们在Pong与一名人类球员一起打球时,他们试图延长比赛而不是赢球。

6月份OpenAI开发的机器人可能会击败Valve的Dota 2中的技术团队。

相关文章

- 马斯克在与OpenAI及奥尔特曼的诉讼案中败诉

- OpenAI的Codex已集成到ChatGPT移动应用程序中

- 奥尔特曼称,马斯克离开OpenAI提振了公司的士气

- OpenAI 新模型密集更新,Meta/微美全息强化布局AI核心需求迎爆发增长!

- OpenAI宣布与AMD、英伟达、英特尔、微软及博通达成超级合作,合力加速AI发展

- ChatGPT下载量放缓,或将影响OpenAI的首次公开募股

- 马斯克出庭作证,诉讼指控OpenAI违背了打造惠及全人类的通用人工智能的核心使命

- OpenAI正式发布GPT-5.5模型,编程能力大幅增强

- OpenAI Sora团队负责人比尔·皮布尔斯即将离职

- OpenAI对Codex进行大更新,直接瞄准了Claude Code

- OpenAI疲于应对公众争议、战略调整以及日益激烈的竞争的局面

- OpenAI收购科技播客节目TBPN,进入媒体赛道

- 大英百科全书起诉OpenAI,指控ChatGPT输出的内容与其几乎完全相同

- OpenAI新模型发布,Meta/微美全息以AI芯片+模型布局加速行业创新进程

- OpenAI发布GPT-5.4模型:具备原生计算机使用能力,能够在各类应用中执行任务

- OpenAI宣布获得亚马逊、英伟达和软银新融资1100亿美元

人工智能企业

更多>>人工智能硬件

更多>>- 一飞智控携全空间解决方案及三款新品,亮相2026世界无人机大会

- 续航超强的微星全新尊爵系列,重塑轻薄本的超凡全能体验

- BOE(京东方)全球首发原生千帧FHD 护眼电竞显示器 真千帧硬实力引领电竞高刷新时代

- Neousys宸曜发布星宸系列强固嵌入式工控机,赋能工业智能升级

- BOE(京东方)OLED技术赋能联想YOGA Air 14 Ultra 定义超轻薄AI PC新标杆

- iQOO 15T正式发布:天玑9500 Monster版加持 全能体验无短板

- 从“+AI”到“AI+”:天禧AI 4.0加持,联想AI主机领衔L3级终端震撼登场

- 拾年匠音,声来不凡,致敬1000X系列十周年 索尼发布1000X十周年典藏版头戴降噪耳机

人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源