富士通开发自动调整计算精度以加速AI处理10倍的技术

2019-12-02 17:10:42AI云资讯973

富士通实验室有限公司日前宣布了一项新的“内容感知计算”技术的开发,该技术可以在提高计算速度的同时控制准确性。该技术是为响应AI技术的发展和普及对计算能力的不断增长的需求而开发的。

将这项新技术应用于深度学习任务有望将计算速度提高十倍,从而使将AI用于更广泛的未来应用程序变得更加容易。

发展背景

近年来,人工智能技术在图像识别和语音翻译等领域的广泛应用导致对处理能力的需求不断增加,使现有技术难以承受极限。为响应这种趋势,已经开发了针对这种性质的AI应用进行了优化的新型GPU和专用处理器。根据特定的应用程序,可以在各种环境中计算AI任务,范围从云环境到边缘计算上下文。提供稳定性和快速处理能力的技术将越来越有必要提供处理苛刻的AI任务所需的计算能力。

问题

图形处理单元(GPU)和专用处理器提高了计算性能,但是还没有赶上AI的计算需求。作为进一步简化AI任务性能的一种手段,人们对减轻计算负担和提高速度的技术的兴趣日益浓厚。

例如,在深度学习中计算神经网络算法时,一种实现更高性能速度的方法是将运算精度从32位降低到8位,并执行4次并行运算。不幸的是,如果均匀地降低操作精度,则操作结果也会恶化。

因此,受过训练的专家必须努力确定应该通过反复试验来降低哪个区域的计算精度。这种方法证明调整很耗时,每当输入数据或执行环境发生变化时都需要重新调整。

关于最新技术

为了克服这些挑战,富士通开发了“内容感知计算”技术,该技术可自动控制并加快计算精度。这可以在包括GPU,CPU,云和边缘在内的各种执行环境中实现更快的AI处理。该技术的特征如下。

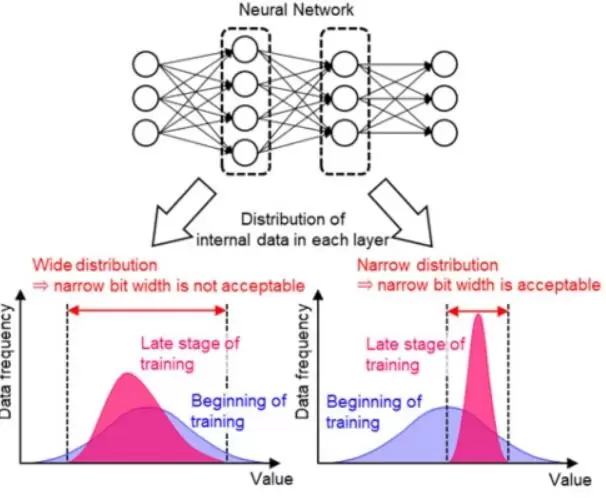

1.自动减少技术

神经网络通常具有数值范围,其中随着学习的进行,每一层都收敛到相似的数值。根据计算过程中神经网络中每一层数值范围的分布,根据学习情况确定计算精度的应用程度,例如分布宽时位宽,而分布宽时位宽。学习是先进的和融合的(图1)。这使得深度学习的速度比以前快三倍,同时减少了计算结果的下降。

2.同步缓解技术,可在并行环境中以性能波动实现高速执行

在云环境或许多应用程序共享CPU的其他环境中,由于通信冲突,处理中断等,对某些节点的响应可能会存在明显的延迟。另一方面,在并行处理的每个操作中,估计终止处理时的处理时间的减少以及对操作结果的影响程度,并且控制每个操作的终止时间,使得可以最大程度地减少处理时间而不会恶化操作结果。这可实现更快的并行处理,从而使深度学习计算中的确认性能快3.7倍。

特效

最终,新开发的技术“ Content-Aware Computing”可以将AI任务的处理速度提高多达10倍。通过将此技术整合到AI框架和库中,可以使用具有内置低位计算功能的GPU和CPU加快云环境和数据中心中的AI处理。

未来的计划

展望未来,富士通的目标是将该技术整合到一个广泛使用的AI框架中,并将成为使用深度学习执行AI服务的基础。

相关文章

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源