Nature:世界最快光子AI加速器

2021-01-11 16:52:27AI云资讯1746

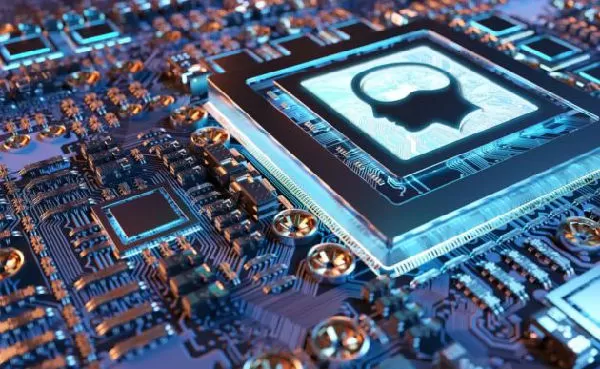

人工神经网络广泛应用于人脸识别、语音翻译、医疗诊断、自动驾驶等重要领域,其性能主要由硬件算力决定,目前所广泛应用的神经网络硬件都基于数字电子架构。然而,该架构的两个本质局限—冯诺曼依瓶颈与电子速率瓶颈,极大限制了神经网络硬件的潜在算力。首先,数字架构中,数据的存储和运算是分布式的,因而在计算过程中,会有大量的能源和算力消耗在数据的反复读取和存储中,此限制被称为冯诺曼依瓶颈。其次,由于电子微处理器中的寄生电容和互联时延问题,电子系统存在着本质的带宽限制,导致电子微处理器的主频事实上在过去十年已没有明显提升,此限制也被称为电子速率瓶颈。

光子神经网络工作于模拟架构中,即数据在硬件系统中的实时位置与进行运算的位置相同,因而规避了冯诺曼依瓶颈。此外,宽达数十太赫兹的光谱也为高速运算提供了充足的带宽。目前已有来自加州大学、麻省理工学院、明斯特大学等单位的研究团队做出了一系列在网络尺度、可集成性、片上存储等方面的突破,然而尚未能实现较高运算速度与高维数据处理能力,光子神经网络的超高运算潜力尚未得到证实。

近日,澳大利亚研究人员徐兴元博士(莫纳什大学)、谭朦曦博士、David Moss教授(斯文本科技大学)、Arnan Mitchell教授(皇家墨尔本理工大学)等首次提出并实现了基于波长、时间交织的光子卷积加速器。该文章以"11 TOPS photonic convolutional accelerator for optical neural networks"为题发表在Nature。

封面图:徐兴元博士(莫纳什大学)展示集成克尔光频梳芯片

图源:莫纳什大学,徐兴元

研究人员通过采用集成高品质因素、高非线性微环与波导色散调控,实现了高相干度、易于产生的集成克尔孤子晶体光频梳。

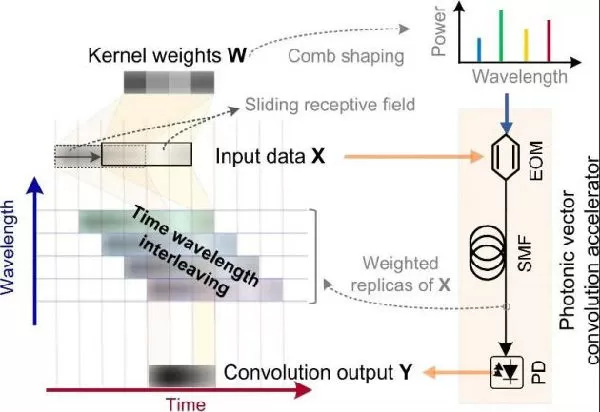

研究人员将该光频梳进行频域整形并且与高速光电调制相结合,实现了输入数据在并行波长通道上的组播与加权,然后采用光学色散介质作为缓存,对组播信号进行了步进延时(步长为单个码元时长),从而在时域上对齐了不同波长通道中需要加权求和的码元,最后通过光电转换实现处理结果的高速实时读取(如图1所示)。通过这一系列步骤,波长构架的卷积窗口(感知域)即可在时域以超过60GBaud的速率滑动,结合克尔光频梳所实现的高并行度(C波段90个波长通道),实现了11 TOPS(太运算每秒)的运算速度,即每秒可完成11万亿次运算。

图1卷积加速器工作原理

图源:Nature 589, 44–51 (2021). Fig 1

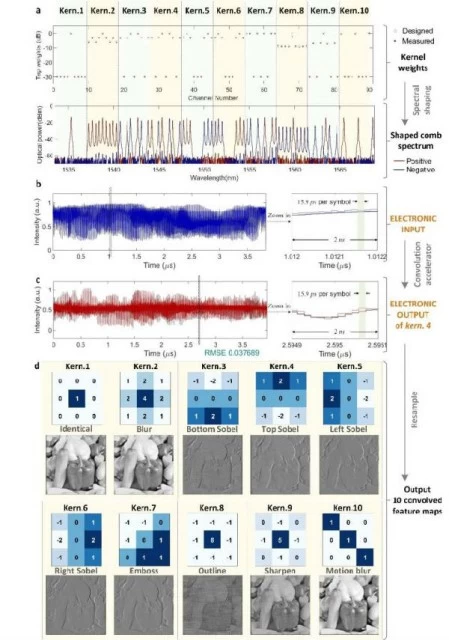

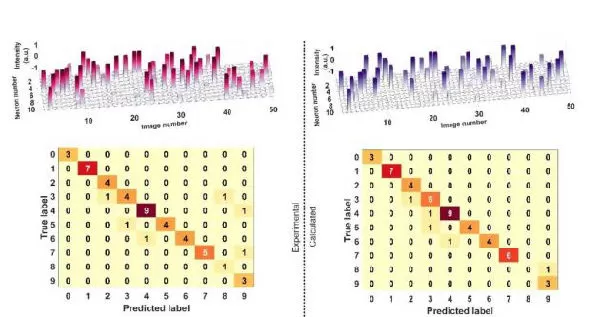

通过这一系列步骤,数学模型抽象的神经元突触就被光频梳在实际物理系统中实现,其中突触连接的权重由光频梳的光功率体现。最终实验验证了高维图片处理(实验结果如图2所示)以及深度学习光子卷积神经网络(实验结果如图3所示)。

图2卷积图像处理结果

图源:Nature 589, 44–51 (2021). Fig 3

在国际相关研究成果的基础上实现了数个突破,包括:

1. 由于集成克尔光频梳所提供的大量波长通道,运算速度首次突破到11 TOPS以上;

2. 首次实现了利用光学手段进行高维数据处理(25万像素点),为光子神经网络的进一步实际应用如人脸识别等展现了可能;

3. 实现了500张MINIST手写数字图片的高速分类预测,准确率达到88%以上;

4. 实现了具备高速光电接口的硬件加速器,速度可达64G Baud以上,并且可与现有电子或者光学硬件兼容互联;

5. 结合应用了集成克尔光频梳,为实现光子神经网络的单片集成奠定了基础。

图3卷积神经网络50张手写数字识别结果。上图为全连接层神经元输出幅度,下图为混淆矩阵。

图源:Nature 589, 44–51 (2021). Fig 6

后续,研究人员将继续优化本方案的性能指标,如处理速度、并行度、体积与可集成性、功耗等。本工作实验证明了光子神经网络硬件的运算潜力,并且具有高速光电接口,未来可作为通用卷积特征提取前端与其他光电模数架构互联,在卷积神经网络中可承担70%以上的运算负荷,大幅提升系统整体算力,在未来实时人工智能应用场景如无人驾驶、医疗诊断等方面有重要应用。

相关文章

- 阳台储能开创者疆海科技完成数亿元 B 轮融资,押注 AI 时代的家庭能源中心

- 开源!鲸智百应升级,浩鲸科技重新定义企业AI原生

- 万兆AI惠商 联通美好未来 ——中国联通东莞市分公司5・17 电信日暨联通客户日活动圆满举行

- 中国联通在北京地区携手华为发布3000M宽带新产品,全光臻宽带矩阵为“双万兆AI提质行动”添砖加瓦

- 超显商城整合核心GLED显示技术,开启显示设备AI定制新模式

- 博大数据荣膺“全球AI生态基石大奖”,夯实融合算力基础设施服务商领先地位

- 全国人工智能发展大会 AI HANGZHOU 2026中国(杭州)国际人工智能展览会

- 酷开发布企业AI操作系统 开启硅基管理新时代

- 酷开AIOS:定义“企业AI操作系统”的野心与挑战

- 华为超千兆新品亮相山西!三频Wi-Fi 7+AI 焕新智慧家庭新生活

- 辽宁与华为联合发布超千兆三频Wi-Fi 7+AI 新品,共筑辽沈智慧家庭新生活

- 亿达科创亮相国际人工智能展再获AI大奖

- 花旗银行报告称,台积电在AI领域的主导地位不会受到英特尔威胁

- 华为云创想者大会主题论坛议程公布:释放Agentic AI新布局

- 与AI同行 3000M助力 共创智家新生活——中国联通品牌与产品辽宁宣传推广会 全面启动联通社区惠民行系列行动

- 以创新设计重塑 AI 路由未来,MOVA LINCO X1 Pro 荣膺红点奖

人工智能企业

更多>>人工智能硬件

更多>>- 一飞智控携全空间解决方案及三款新品,亮相2026世界无人机大会

- 续航超强的微星全新尊爵系列,重塑轻薄本的超凡全能体验

- BOE(京东方)全球首发原生千帧FHD 护眼电竞显示器 真千帧硬实力引领电竞高刷新时代

- Neousys宸曜发布星宸系列强固嵌入式工控机,赋能工业智能升级

- BOE(京东方)OLED技术赋能联想YOGA Air 14 Ultra 定义超轻薄AI PC新标杆

- iQOO 15T正式发布:天玑9500 Monster版加持 全能体验无短板

- 从“+AI”到“AI+”:天禧AI 4.0加持,联想AI主机领衔L3级终端震撼登场

- 拾年匠音,声来不凡,致敬1000X系列十周年 索尼发布1000X十周年典藏版头戴降噪耳机

人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源