阿里云机器学习平台PAI与华东师范大学论文入选SIGIR 2022

2022-07-12 10:33:41AI云资讯1452

近日,阿里云机器学习平台PAI与华东师范大学高明教授团队合作的论文《结构感知的稀疏注意力Transformer模型SASA》被顶会 SIGIR 2022录取。论文主导通过引入稀疏自注意力的方式来提高Transformer模型处理长序列的效率和性能,并提出了结合代码语言和结构特性的面向长代码序列的Transformer模型性能优化方法。

SIGIR是人工智能领域智能信息检索方向顶级国际会议,涉及搜索引擎、推荐系统等多个方向,该会议曾推动了面向搜索的排序模型、基于深度学习的推荐算法等人工智能领域的核心创新,在学术和工业界都有巨大的影响力。此次入选意味着阿里云机器学习平台PAI自研的稀疏注意力Transformer模型达到了业界先进水平,获得了国际学者的认可,展现了中国机器学习系统技术创新在国际上的竞争力。

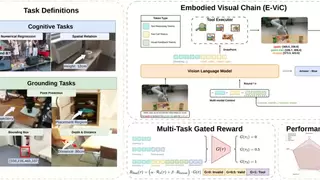

那么SASA主要解决了什么问题?基于Transformer的模型在self-attention模块的复杂度随序列长度呈次方增长,多数编程预训练语言模型(Programming-based Pretrained Language Models, PPLM)采用序列截断的方式处理代码序列,从而导致上下文信息缺失。

针对以上问题,SASA设计了四种稀疏注意力模式,包括:sliding window attention,global attention,Top-k attention,AST-aware attention,在一定程度上将计算复杂度与序列长度解耦。其中sliding window和Top-k模式基于局部上下文和重要的attention交互学习表示,抽象语法树(AST)模式引入代码的结构特性,与序列上下文信息相互补足,global attention通过与序列中所有token进行交互来获取全局信息。对比CodeBERT,GraphCodeBERT等方法,SASA在多个长代码任务上取得最佳效果,同时也降低了内存和计算复杂度。

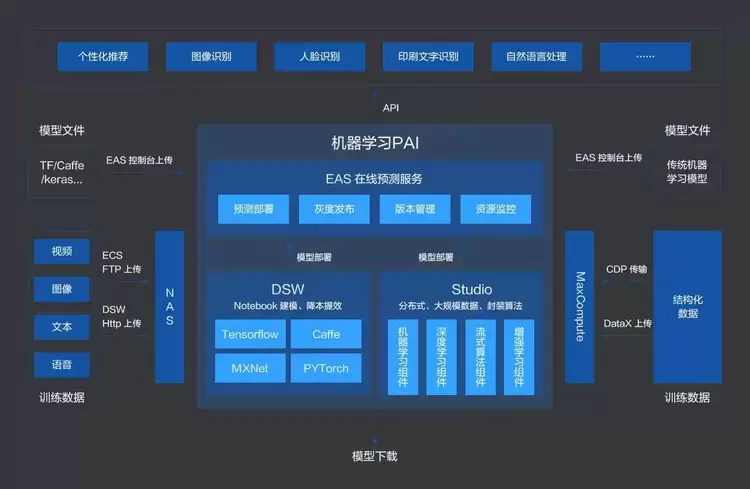

SASA技术将在开源框架EasyNLP中集成,给PAI的NLP开发者提供基于稀疏注意力机制的长序列自然语言处理能力。机器学习平台PAI面向企业客户级开发者,提供轻量化、高性价比的云原生机器学习,涵盖PAI-DSW交互式建模、PAI-Designer可视化建模、PAI-DLC分布式训练到PAI-EAS模型在线部署的全流程。

论文信息

EasyNLP开源地址:https://github.com/alibaba/EasyNLP

论文链接:https://arxiv.org/abs/2205.13730论文名字Understanding Long Programming Languages with Structure-Aware Sparse Attention. SIGIR 2022论文作者刘婷婷,汪诚愚,陈岑,高明,周傲英

相关文章

- 阿里云发布Token-Watt八大前沿课题,推动共建算电协同新业态

- 阿里云推出企业级Agent构建平台JVS Crew:零代码“建龙虾工厂”

- 至强® 6处理器在阿里云第九代ECS实例中的应用案例:货拉拉大促高并发实践

- 合合信息亮相2026金融AI联盟大会,携手阿里云共同启动“超级智能体计划”

- 阿里云数字短信全量开放,终端全覆盖实现营销短信点击率3倍提升

- 阿里云Q3财报:增速36%创新高,AI连续三位数增长!

- 上海数据集团、阿里云、浩鲸科技深化战略合作 发力AI时代数据要素

- 连登顶会!阿里云研究成果大幅提升运维智能精度与效率

- 阿里云金山算力中心加速投产,基于“真武”芯片建设超大规模算力中心

- 黄飞对话阿里云AI专家:当零售中台拥有AI大脑,未来将去向何方?

- 生态共进:昆仑智云以阿里云认证伙伴身份,破解AI落地“最后一公里”

- 昆仑智云:以阿里云认证生态伙伴身份,破解企业AI“三无困境”

- 全来店亮相 2026 阿里云 PolarDB 开发者大会

- 阿里云支持鹰角3D新游《明日方舟:终末地》全球开服

- 风行在线携手阿里云通义大模型,AI漫剧创作平台“橙星梦工厂”,引领数字内容生产新范式!

- 阿里云AI火花大会:AI加速从单点创新迈向规模化落地

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源