谷歌将Marvell纳入双芯片TPU计划,ASIC AI推理格局或将重塑

2026-04-20 09:50:06AI云资讯2466

(AI云资讯消息)消息称,谷歌正与美满电子(Marvell)联合推进两款芯片的开发工作:一款旨在对当前TPU架构进行性能优化,另一款则是面向未来的下一代TPU设计方案。目前已启动初步磋商。

双方谈判究竟进展到哪一步尚属未知,但从初步披露的信息看,谷歌已提出双芯片方案:一款用于增强现役TPU,另一款则是全新的TPU架构。这意味着,合作的基本路线图已然划定。

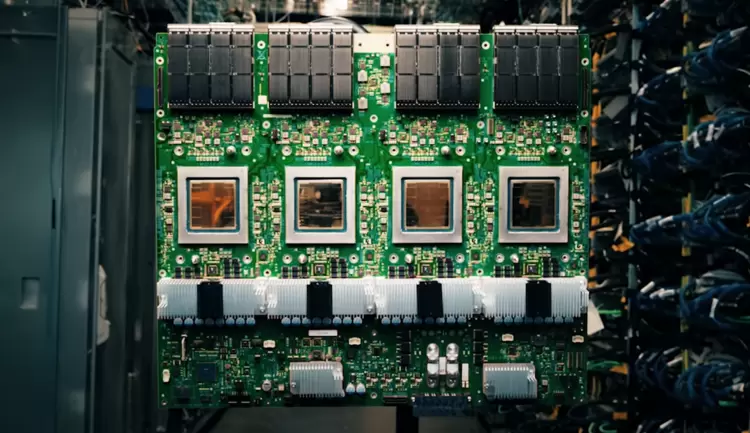

这两款讨论中的芯片定位截然不同。第一款并非我们通常理解的那种定制TPU计算芯片,而是一块专门负责处理内存的单元,它将与TPU搭配工作。简单来说,这款特定的加速器或IP模块会把主芯片或系统的一部分内存运算压力分担出去,交给这颗专用的MPU来处理,即所谓的“内存内处理”。

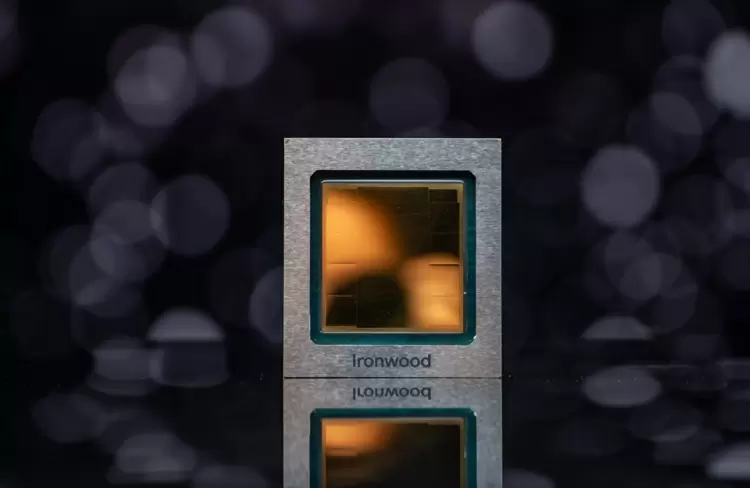

第二款正在洽谈的芯片则定位为新一代TPU,主打AI推理模型场景的专项优化。现阶段,谷歌旗下最顶尖的AI加速器当属TPU v7(Ironwood系列),其单颗芯片搭载192GB HBM高带宽内存,峰值性能高达4614万亿次浮点运算(TFLOPs),并可通过Superpod架构将9216颗芯片聚合成超大规模算力集群。

虽说ASIC在AI推理赛道被寄予厚望,但产业链的隐忧尚未消散。一方面,有消息显示谷歌Ironwood系列TPU的需求势头渐猛;另一方面,却不得不正视产能瓶颈因为各大主要晶圆厂的产线目前均已满载运转。

从定位上看,这款MPU更像是与英伟达Groq 3 LPX类似的协处理推理加速器,也就是所谓的LPU(语言处理单元)。其搭载了500MB的SRAM高速缓存,并实现了150 TB/s的恐怖总带宽,旨在让即将问世的Vera Rubin平台在运行Agentic AI任务时发挥出极致效能。

种种迹象表明,谷歌的下一代TPU或将与那款MPU深度绑定。通过这种异构计算架构,内存子系统的数据搬运效率将获得二次加速,这意味着未来AI模型在推理部署时的响应速度会更快。

相关文章

- 谷歌搜索的人工智能进化包含更多广告

- 谷歌的未来是一个无所不能的搜索框

- Google I/O 2026:Gemini 将成为谷歌年度开发者大会的主角

- 2026智能眼镜“百镜争鸣”,谷歌/阿里/微美全息引领AR/XR产业全面升级

- 谷歌发布 Chromebook 后继产品——Googlebook

- 谷歌称其首次发现并阻止了一个利用AI开发的零日漏洞

- 谷歌首款AI眼镜即将呼之欲出,微美全息(WIMI.US)扎实推进AI+AR生态落地

- 谷歌母公司发布2026年一季度财报,搜索查询量创下历史新高

- 英伟达Rubin芯片落地谷歌A5X实例,多站点集群规模扩展至近百万颗GPU

- Siri悄然接入Gemini大模型,苹果反成谷歌云2026 Next大会主角

- 联合谷歌共建:戴盟发布数百万小时触觉具身数据集

- 谷歌将Marvell纳入双芯片TPU计划,ASIC AI推理格局或将重塑

- 谷歌推出Mac版Gemini人工智能应用

- Meta闭源模型Muse Spark登场,谷歌/微美全息加码投入开源AI“严阵以待”

- 谷歌正式接管母公司Alphabet旗下机器人软件企业Intrinsic

- 谷歌云客户业务负责人重返微软,出任安全主管

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源