核武器也用人工智能(AI)?构想太疯狂,一旦判断失误后果不堪设想

2018-11-19 11:10:57AI云资讯1126

第一次世界大战结束已经100周年了,这次战争从根本上宣告了现代化战争的到来,飞机、坦克、机枪等新型武器陆出现在战场上,大大提高了战争的效率。而今世界又一次站在了战争方式革命性变革的边缘,这次的变革主要是由人工智能(AI)技术的发展驱动的。

但是否应当将人工智能(AI)应用于战争决策引起了巨大的争议,谷歌员工用大规模离职的方式抗议公司同国防部合作人工智能(AI)项目仅仅只是个开始,可以想象,当人工智能(AI)技术应用于核武器发射控制决策时,会带来多大的危险。

当前,人工智能(AI)持续发展,在这一领域,美国、俄罗斯、中国持续进行竞赛,这不仅仅是科技方面的竞赛,要知道三国有一个共同的标签“核大国”,三国拥有的核武器据称占到了世界的90%以上。这就意味着,各国拥有更多的责任来确保不仅仅是相互威慑,更应该紧密合作,确保不会破坏当前核武指挥和控制体系的稳定,以免造成严重后果。

毋庸置疑,这种破坏是存在可能性的,而在核武方面,人类承担不起哪怕一点点的可能。

1983年,当斯坦尼斯拉夫·彼得罗夫上校在莫斯科郊区一座核导弹预警中心工作时。遇袭警报突然响起,雷达显示多枚核导弹正同时从美国一座军事基地向苏联袭来。彼得罗夫权衡再三,当作假警报处理,没有按照规定向上级汇报并申请反击,调查证明,彼得罗夫判断正确。苏联卫星误把云层反射的阳光当作洲际弹道导弹发动机喷射的痕迹。他的决定很可能阻止了一场足以导致世界毁灭的核大战。

1960年,位于格陵兰岛图勒基地的早期预警雷达站向北美防空防御司令部报告,它侦测到苏联向美国发射了多枚导弹,几十分钟后就将落到美国本土。北美防空司令部如临大敌,立刻进入最高警戒级别,时刻准备进行反击,千钧一发之际,有人想起苏联领导人赫鲁晓夫当时正好在纽约参加联合国大会。考虑到赫鲁晓夫连续几天都在联合国大会上发表演说,看上去丝毫没有要同美国打世界大战的迹象,疑惑的五角大楼和白宫高层抓紧最后机会,下令复核雷达侦测结果。最终惊出一身冷汗的军方发现,原来刚部署在格陵兰岛的AN/FPS-50预警雷达性能不完善,虽然它的探测功率强大,但识别能力却很差,当挪威上空升起月亮时,它收到大量雷达回波信号,误以为是苏联对美国的大规模导弹攻击,发出了虚警。

这种卫星乃至雷达的失误,都有极大可能引发大规模核战争,何况当人工智能(AI)出现失误时,又会引起什么样的后果,我们不敢想象。同样,美国国会外交关系委员会就提出,在人工智能(AI)之际快速发展的今天,核国家之间应该就该技术对稳定的破坏潜力达成一个有效的协议,确保人工智能(AI)不会对核武器指挥和控制体制的稳定造成破坏。相关文章

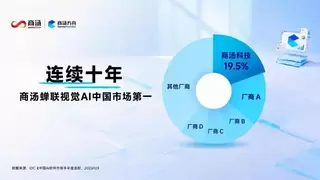

人工智能企业

更多>>人工智能硬件

更多>>- 一飞智控携全空间解决方案及三款新品,亮相2026世界无人机大会

- 续航超强的微星全新尊爵系列,重塑轻薄本的超凡全能体验

- BOE(京东方)全球首发原生千帧FHD 护眼电竞显示器 真千帧硬实力引领电竞高刷新时代

- Neousys宸曜发布星宸系列强固嵌入式工控机,赋能工业智能升级

- BOE(京东方)OLED技术赋能联想YOGA Air 14 Ultra 定义超轻薄AI PC新标杆

- iQOO 15T正式发布:天玑9500 Monster版加持 全能体验无短板

- 从“+AI”到“AI+”:天禧AI 4.0加持,联想AI主机领衔L3级终端震撼登场

- 拾年匠音,声来不凡,致敬1000X系列十周年 索尼发布1000X十周年典藏版头戴降噪耳机

人工智能产业

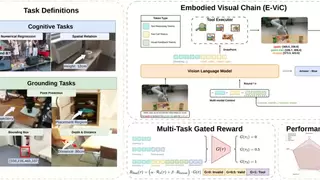

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源