麻省理工学院林肯实验室开发人工智能展示其决策过程

2018-12-28 11:08:17AI云资讯1516

在麻省理工学院林肯实验室智能与决策技术小组发表的一篇论文中(“设计的透明度:弥合视觉推理中的性能与可解释性之间的差距”)今年夏天在计算机视觉和模式识别会议(CVPR)上发表,研究人员描述了执行“人类”推理以回答有关世界的问题的系统-即图像的内容。

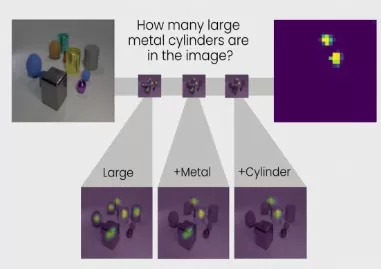

神经网络-被称为透明度设计网络(TbD-net)-用热图描绘其视觉分析。在对照片进行解读时,它会以明亮,易于识别的颜色(用于研究人员的说法中的“注意力掩模”)突出显示感兴趣的项目,这些颜色代表模块的输出,或专门用于执行特定任务的小型神经网络。

麻省理工学院新闻报道称,“就像工人下线一样,每个模块都会在模块出现之前建立最终产生最终正确答案的模块。”“作为一个整体,TbD-net利用一种AI技术来解释人类语言问题并将这些句子分解为子任务,然后是多种计算机视觉AI技术来解释图像。”

那么它怎么能回答像“大金属立方体是什么颜色”这样的问题呢?首先,模块会隔离大对象。然后第二个模块将识别哪些对象是金属。第三个将查找符合先前标准的立方体,最后,第四个将确定对象的颜色。

在涉及85,000个训练图像和850,000个问题的测试中,TbD-net的准确度为98.7%,优于其他基于神经模块网络的方法。更重要的是,它实现了最先进的性能-99.1%的准确度-部分归功于它产生的热图插图,这使得研究人员可以非常精确地调整它以进行后续测试。

这篇论文的作者认为,对神经网络推理的这种洞察力可能对建立用户信任大有帮助。

最近几个月,许多公司,政府机构和独立研究人员试图解决人工智能中所谓的“黑匣子”问题-一些人工智能系统的不透明性-并取得了不同程度的成功。

2017年,美国国防高级研究计划局启动了DARPAXAI计划,旨在生产“玻璃盒”模型,在不牺牲性能的情况下轻松理解。今年8月,IBM的科学家们提出了一份人工智能的“情况说明书”,它将提供有关模型漏洞,偏见,对抗性攻击易感性和其他特征的信息。微软,IBM,埃森哲和Facebook开发了自动化工具来检测和减轻AI算法中的偏差。

“人工智能系统具有改变我们生活和工作方式的巨大潜力......[但]这些[透明度]问题必须得到解决才能让人工智能服务得到信任,”IBM研究院和联合会的AI基金会负责人AleksandraMojsilovic说道。8月份接受VentureBeat采访时,人工智能科学促进社会福利计划。

相关文章

- 超擎数智获授“ODCC AI存储实验室”, 创新引领大规模推理应用新纪元

- 超擎数智获授“ODCC AI存储实验室” 创新引领大规模推理应用新纪元

- 进军欧洲市场——戴纳科技与WALDNER签署黑灯实验室代理协议

- 戴纳科技与盛虹石化达成战略合作 携手打造化工领域黑灯实验室新标杆

- 从产线到院校实验室:王森城率灵科超声波以技术赢得顶尖认可

- 2026智能实验室创新发展研讨会在京举办 发起设立中关村智能实验室联盟

- 天翼视联视觉智安实验室正式揭牌 重塑视联网行业安全生态格局

- 德施曼联合B站,在2026AWE打造年轻人的“智能锁”测评实验室

- 德施曼联合B站 在2026AWE打造年轻人的“智能锁”测评实验室

- 从实验室到全球网络,慧博云通用十六年构建泛智能终端与移动通信的“质量守护网”

- 点猫科技向七地捐赠春晚机器人AI实验室,共筑人工智能教育未来

- 长江经济带最闪亮的科创之星!亿纬锂能荆门研究院龙泉实验室正式揭牌

- Anyty(艾尼提)产品赋能文博考古“现场移动实验室”建设

- 香港科技大学与英特尔共建联合实验室,聚焦高能效智能计算

- 守护全景场健康,圣奥实验室扩项获CNAS评审认可,再添品质硬核防线

- 从尾货处理到新品试销,好特卖如何成为品牌的零售实验室?