出门问问Mobvoi AI Lab三篇论文获ICASSP 2019接收

2019-02-11 15:23:33AI云资讯1709

ICASSP 2019将于2019年5月12日-17日在英国布莱顿拉开序幕,作为国内AI语音赛道独角兽公司的出门问问Mobvoi AI Lab有三篇论文已经被ICASSP 2019接收。ICASSP 全称 International Conference on Acoustics, Speech and Signal Processing(国际声学、语音与信号处理会议),是由 IEEE 主办的全世界最大的,也是最全面的信号处理及其应用方面的顶级学术年会。

出门问问是一家以语音交互和软硬结合为核心的人工智能公司。2012年创立后,出门问问始终以定义下一代人机交互方式为使命,坚持做AI应用的探索,希望用“AI唤醒生活”,让每一个人都能够感受到,以语音交互为代表的AI科技可以给每个人带来的美好与便利。

技术方面,出门问问拥有全套自主研发的智能语音交互八大关键核心技术,掌握600多项技术专利。从1.前端声音信号处理,到2.热词唤醒,到3.语音识别,到4.自然语言理解和5.对话管理,到6.垂直智能搜索和7.推送,到8.语音合成,在这一整套“听到-识别-处理-输出”的人机交互过程中,出门问问可以自主提供所有技术,为需要语音交互的场景提供一整套端到端人机交互解决方案。

出门问问始终坚持产学研高度一体化,在语音交互技术上一直深入探索,由IEEE院士(IEEE Fellow)黄美玉博士领导的出门问问Mobvoi AI Lab,在此次ICASSP 2019提交的论文概述如下。

【1】信任正则化的知识蒸馏在递归神经网络语言模型上的应用

Knowledge Distillation for Recurrent Neural Network Language Modeling with Trust Regularization

Yangyang Shi, Mei-Yuh Hwang, Xin Lei,

Mobvoi AI Lab,Seattle, USA

Haoyu Sheng

Williams College

基于递归神经网络的语言模型较于传统的n-gram语言模型,有显著的性能提升,已经成为语言模型的主流模型,在很多云端应用中得到广泛的青睐。然而递归神经网络语言模型在实际应用中需要占据大量的内存容量以及计算资源。在很多移动终端,由于有限的内存以及功耗,极大的限制了递归神经网络语言模型的应用。最近知识蒸馏的方法被用于压缩递归神经网络语言模型并减少它在终端装置上的计算量。这一篇文章也同样采用了知识蒸馏的方法,并用信任正则化的方法对知识蒸馏方法做出了改进。文章的实验表明这种信任正则化的知识蒸馏方法,可以把 Penn Treebank 数据集的递归神经网络的模型大小降到原有大小的33%,而仍然得到当前学术界最好的结果。在华尔街日报语音识别的任务中,这篇文章的实验表明,信任正则化的知识蒸馏方法可以将递归神经网络语言模型的大小降到原有大小的18.5%,并且仍然保持和原有模型一样的效果。

【2】基于高阶LSTM-CTC的端到端语音识别

End-To-End Speech Recognition Using A High Rank LSTM-CTC Based Model

Yangyang Shi,Mei-Yuh Hwang,Xin Lei

Mobvoi AI Lab, Seattle, USA

基于LSTM-CTC的端到端语音模型,由于其简单的训练过程以及高效的解码过程,最近在语音识别领域得到广泛的关注和应用。在传统的LSTM-CTC模型中,一个瓶颈投影矩阵将LSTM隐层的输出向量投影到CTC的输入向量。研究表明增强这个瓶颈投影矩阵的阶数可以提高LSTM模型的表达能力。这篇文章提出用一个高阶的投影层替代传统的投影矩阵。高阶投影层以LSTM的隐层的输出向量作为输入,经过一系列的投影矩阵以及非线性函数,这个高阶投影层的输出是一系列向量的线性组合。在高阶投影层中,这些线性组合的权重也是由模型根据训练数据学习得到。文章的实验表明在语音领域普遍采用的WSJ数据集以及Librispeech数据集合上,较于传统的LSTM-CTC的端到端语音模型,高阶的LSTM-CTC模型可以带来3%-10%相对词错误率的下降。

【3】使用对抗性样例提升基于注意力机制端到端的神经网络关键字检出模型

Adversarial Examples for Improving End-to-end Attention-based Small-Footprint Keyword Spotting

Xiong Wang, Sining Sun, Changhao Shan, Jingyong Hou, Lei Xie,

School of Computer Science, Northwestern Polytechnical University, Xi’an, China

Shen Li, Xin Lei

Mobvoi AI Lab, Beijing, China

本文提出使用对抗性样例来提升关键字检出(Keyword spotting,KWS)的性能。 对抗性样例近年来在深度学习领域是一个研究热点,它是指在原来正确分类的样例上加一个轻微的扰动后即被分类器错误分类的样例。 在KWS任务中,将系统误唤醒或误拒绝的错误样例视为对抗性样例非常直观而贴切竞争性样例的概念。在我们的工作中,我们首先建立了一个训练有素的基于注意力机制端到端的KWS模型,然后使用快速梯度符号法(FGSM)生成了对抗性的样例,发现这些样例会显著降低KWS的性能,最后我们利用这些对抗性的样例作为增强数据来一起训练KWS模型。最终在出门问问智能音响上收集的唤醒词数据集上进行了实验。实验结果显示,设定阈值在每小时1.0次误唤醒情况下,提出的方法获得了相对44.7%的误拒绝率的降低。

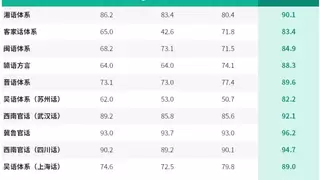

作为AI语音领头公司,出门问问2018年开始在学术顶会发表重要论文,并在麦克风阵列噪声消减、口语理解、噪声环境下的语音识别、带口音的语音识别中实现重大突破。

未来,出门问问不仅要做人工智能技术的前锋探索者,更要做人工智能应用的奠基人,既保持前端技术的研发能力,同时拥有扎实的落地应用能力,ToC通过AI可穿戴、车载、智能家居消费级智能硬件+ToB通过AI企业服务双轮战略驱动,继续探索,用AI唤醒更多人的生活。

相关文章

- 出门问问携TicNote亮相全球共享发展行动论坛

- 出门问问首发AI原生协作平台CodeBanana,以《超级组织》重写AI时代的进化法则

- 出门问问向AI原生组织转型,Token消耗成本占人力15%

- 出门问问2025年亏损收窄90.5%,AI驱动组织效能量级跃迁

- 出门问问发布全球首款4G AI录音耳机 TicNote Pods,联合Alpha派推出金融投研版“涨听”

- 超越记录,打造协作新生态|出门问问TicNote系列新品亮相CES 2026

- 驱动AI原生组织进化!出门问问发布TicNote Cloud平台及系列AI硬件

- CES 2026|出门问问发布TicNote系列新品,联动TicNote Cloud打造团队协作新生态

- 搭载全新升级Shadow AI 2.0,出门问问打造TicNote硬件矩阵与协作生态

- 出门问问全新TicNote生态即将亮相CES,驱动AI原生组织发展

- 出门问问重磅发布TicNote Pods,“4G联网+Shadow AI”重塑耳机体验

- 出门问问发布TicNote Lite青春版,打造年轻人的AI思考伙伴

- 出门问问重磅发布TicNote Color系列,Shadow AI 2.0全面升级

- 穿越周期:出门问问“软硬结合”战略步入收获期,中期亏损近乎清零

- 出门问问TicNote销量居录音同品类热卖榜第一名

- 当AI学会主动思考:WAIC现场,出门问问TicNote让记录“活”起来

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源

- 百度千帆深度研究Agent登顶权威评测榜单DeepResearch Bench

- 在MoltBot/ClawdBot,火山方舟模型服务助力开发者畅享模型自由