浪潮AI服务器大幅提升NLP模型Transformer训练性能

2019-09-12 17:05:14AI云资讯831

近日,在北京举行的2019人工智能计算大会(AICC 2019)上,浪潮发布主流自然语言处理(NLP)模型Transformer的最新性能测试数据。Transformer模型参数规模可达数亿,对计算、通信的要求非常高。性能数据显示,相比同类服务器,浪潮AI服务器NF5488M5大幅提升了Transformer的训练性能,GLUE基准训练至80.4%的时间相比同类产品大幅减少67%。

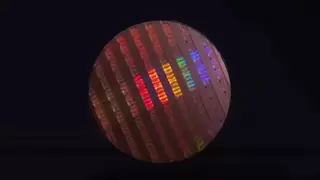

浪潮AI服务器NF5488M5

人工智能正在由“能看、会听”的感知智能向“能读、会写”的认知智能迈进。由于文字是信息、思想的重要载体,如果计算机能够理解文字并能够用文字表达,那么就具备了读写能力,因而NLP被认为是认知智能的重要突破口。目前主流的NLP模型包括Transformer, Bert, GPT, XLNet等,而Bert和GPT都基于Transformer架构。Transformer被视为是NLP的经典模型,2017年由谷歌提出,其利用自注意力(self-attention)机制实现快速并行,并且可以增加到非常深的深度,充分发掘DNN模型的特性,提升模型准确率。

但是Transformer模型训练是一大难题,因为其参数规模达到数亿,对计算力的需求很大。OpenAI的Transformer模型有12层、768个隐藏单元,使用8块P100 GPU在8亿词量的数据集上训练40个Epoch需要一个月。背后的原因很大程度上在于GPU通信制约。Transformer Attention机制的全连接层计算时会产生海量参数,而更新参数梯度需要GPU间高速传输。同时,模型规模很大导致占用大量GPU显存,而batchsize通常都很小,导致每次计算的时间较快,计算后更新参数梯度频繁,这也进一步要求更高的GPU间传输速度。

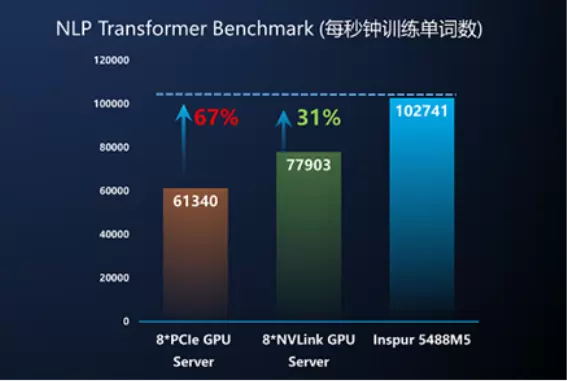

浪潮AI服务器NF5488M5 通过无阻塞的GPU全互连设计,突破性地实现了All to All 300GB/s的Peer to Peer带宽。在当前深度学习通信模型All Reduce性能表现上,NF5488M5的实际通信带宽可以达到采用常规NVLink互联的GPU服务器的3倍以上。正是这种特性,大大提升了Transformer模型在NF5488M5上的通信效率,从而加大了计算通信比,节约了整体运行时间。测试结果表明,NF5488M5大幅提升了Transformer训练性能,GLUE基准训练至80.4%的时间比采用PCIe互联的8GPU服务器缩短67%,比采用常规NVLink互联的8GPU服务器缩短31%。

Transformer训练性能测试结果

浪潮集团AI&HPC总经理刘军认为,当前基于Transformer的Bert, XLNet等模型代表了NLP的发展方向,而它们的特点就是加速器间通信制约。测试结果充分表明浪潮AI服务器NF5488M5在GPU间通信效率上具有显著领先优势,能够大幅提升Transformer等大型AI工作负载的训练性能,降低训练成本,加速认知智能研发和应用落地。

浪潮是人工智能计算的领导品牌,AI服务器中国市场份额保持50%以上,并与人工智能领先科技公司保持在系统与应用方面的深入紧密合作,帮助AI客户在语音、语义、图像、视频、搜索、网络等方面取得数量级的应用性能提升。浪潮与合作伙伴共建元脑生态,共享AI计算、资源与算法三大核心平台能力,助力行业用户开发并部署属于自己的“行业大脑”,加速推进产业AI化落地。

相关文章

- 悬镜安全:穿越周期 在AI浪潮中定义数字供应链安全新范式

- 浪潮计算机亮相通信盛会!以多元智算产品赋能行业发展新未来

- 浪潮下,开目软件与国产工业软件的AI破局之道

- 浪潮 KaiwuDB 亮相 OpenClaw 开发者日,分享Agentic AI 时代数据底座建设思路

- 浪潮开务时序基础模型正式发布

- 数字峰会探新“智”|为AI装上“质检员”,浪潮软件集团发布大模型“体检”方案

- 传音控股出海新篇章:共创共享,融入新兴市场数字化浪潮

- DeepSeek-V4 上线国家超算互联网:以普惠算力与开发者共逐AI新浪潮

- 2026 Q1光通信电源收入同比增166.16%!鼎阳科技拥抱AI+光通信浪潮

- 从全域覆盖到价值深耕,浪潮云海超融合五大行业市占率第一

- Aginode安捷诺:OpenClaw开启的智能体浪潮,如何重塑下一代智算网络?

- 在时代的浪潮中前行:黄宏生与创维的务实之道

- 从Agent 浪潮到组织变革,腾讯云携手业界专家共探OpenClaw时代的安全边界与企业进化

- “十五五”开局之年,国产操作系统在AI浪潮中书写中国方案

- 资源全面利旧,助推云架构再升级,浪潮云海助力长城汽车云平台建设

- 养虾引爆执行式AI浪潮,微盟导购Agent打通零售AI全链路

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源