炬芯科技推多模态智能交互芯片平台开启新的交互方式

2020-02-20 16:06:25AI云资讯1489

从电脑还是离不开物理按键键盘开始,到手机、车载显示器,点触即可,再到后来,一种新的交互方式随着智能音箱的普及刷新了我们的生活,它就是智能语音交互。连屏幕都不用看了,想听啥歌张嘴就行,真正解放双手。很多人也许会新鲜的觉得,这种交互方式会是未来的趋势,其实并不是,未来最好的交互方式会是什么呢?毋庸置疑它肯定比智能语音更高级,它就是多模态交互技术。

大部分听到多模态的时候,也许会有点蒙圈,因为这个词确实没有智能语音那么好理解。这个创新概念是在 2015 年 12 月,图灵机器人团队推出 Turing OS 机器人操作系统时提出的。手机有操作系统,机器人也要有操作系统。Turing OS 机器人和人之间的交互方式,就叫做“多模态交互”。模态也就是英文里的“modality”,翻译过来就是感官。而多模态就是把“文字、语音、视觉、动作、环境”等多种方式融合在一起。说白了,这个交互的本质就是“让机器也有感情”。

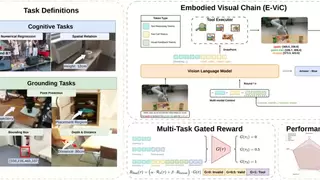

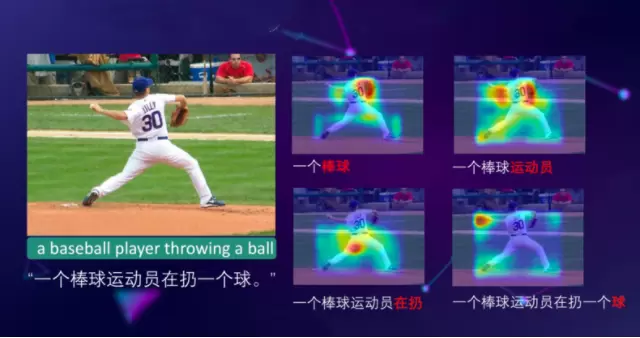

接下来,让我们通过上面的一张图片了解多模态交互技术赋予机器的深度学习能力到底有多强。如果我们用深度学习来看上图,会生成这么一句话:一个棒球运动员在扔一个球。为什么会生成这么一句话?比如,我们发现模型“看”成这个图片的时候,它实际上先是注意力集中在棒球手套这个地方,这是一个特征表明这是一个棒球运动。随后当计算机注意到跟广的区域的时候,它会提出这是个运动员。再往下,当AI模型注意到一个大腿扭曲的姿态的时候,它会认为这是一个人的动作,凭这些,计算机会认为这是一个人扔球的动作,虽然这个球的占的整面积非常小,但是因为语言模型在语义上的驱动,使得这个球也能够被识别出来,最后形成一句完整的有意义的话。这就是跨越视觉和语言两个模态,从图片到文本描述生成的过程。

想要让机器拥有如此强大的深度学习能力,让它听明白和看明白人类的动作和需求,离不开机器需要一颗强大的硬件芯片。强人工智能主要是指能够学习知识、思考问题和解决问题的的通用智能,机器具有多通道的知觉并且具有意识,在各方面都能和人类比肩。人工智能如果需要在生活中有更好的体验,我们希望它能像人体一样,能耳目鼻口协同工作,主动提供服务。

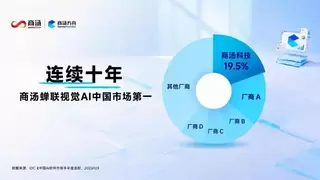

经过半个世纪的发展,在近十年,人工智能技术步入了发展的快车道,高性能的计算芯片甚至 AI 芯片、海量的数据积累和优秀的软件算法都在推动人工智能向更深处不断发展。炬芯科技在单模态交互芯片设计上拥有多年的经验积累,相关产品广受市场认可。面对人工智能的时代跃迁,炬芯正向着更进一步的技术延伸发展。国产芯片核心玩家,声音前处理专家炬芯科技抢先推出旗下首颗多模态交互芯片:炬芯ATS3609D,是拥有多麦智能语音、轻智能图像、手指点读双模态识别输入解决方案。炬芯ATS3609D 将语音交互、机器视觉和传感器三个模态综合起来,为强人工智能下的多模态交互提供可行的解决方案。充足的算力,超低的功耗、强大的可扩展性,将赋予智能机器更多的可能性。

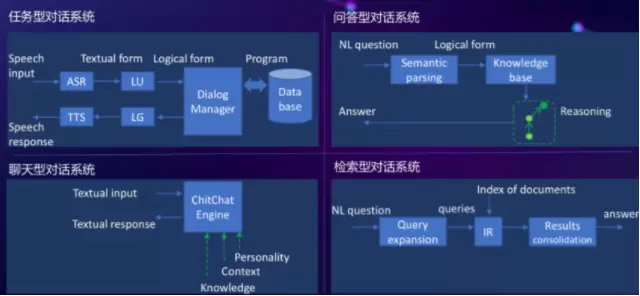

随着AI技术的发展,特别是人机对话、文本生成、情感智能技术的提升,我们开始逐渐进入到人机融合、多模态智能交互的产业时代,通过大规模多模态交互与对话技术,我们能够对数字世界,比如银行帐号、各种各样的数字资产进行管理,甚至还能通过AI更好的在情感世界和物理世界进行沟通,希望随着人工智能尤其是NLP和其他多模态智能的发展,我们可以做到真正的人机融合。

相关文章

- 持续落地!炬芯科技刷新消费级AR、AI眼镜芯标准

- 端侧新品,炬芯科技 ATS288X AI-Party Speaker 芯片重磅发布

- 炬芯科技端侧AI音频芯片ATS323X荣获”2025年度中国IC设计成就奖”

- 炬芯科技再发端侧 AI音频芯片 ATS362X 低功耗大算力引爆音频新浪潮

- 炬芯科技助力VIZIO打造二合一家庭娱乐音频产品

- 喜讯!炬芯科技ATS3031荣获“2024全球电子成就奖之年度创新产品”

- 炬芯科技周正宇:Actions Intelligence 端侧AI音频芯未来

- 炬芯科技联合驊訊电子推出颠覆性Xear™ 7.1.4 全景3D空间音频无线电竞耳机方案,重新定义游戏音效

- 炬芯科技高音质蓝牙音频芯片获LGE XBOOM Go系列无线音箱采用

- 炬芯科技低延迟高音质蓝牙音频芯片荣获“2023-2024年度半导体市场最佳产品”

- 炬芯科技上榜2024 中国IC设计Fabless 100 排行榜之TOP 10无线连接公司

- 炬芯科技智能手表芯片助力荣耀亲选新一代智能手环海外上市

- 炬芯科技布局汽车音频DSP芯片领域

- 炬芯科技周正宇:焕新声音活力,AI驱动下的音频芯片创新

- 炬芯科技助力小米Redmi Watch 3 青春版,打造腕上大屏自在的通话体验

- 炬芯科技助力索尼推出清晰澎湃音质的蓝牙音箱新品

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源