谷歌使用AI追踪2D视频中的物体 或可用于自动驾驶汽车物体识别

2020-04-02 11:50:06AI云资讯1044

(图片来源:ai.googleblog.com)

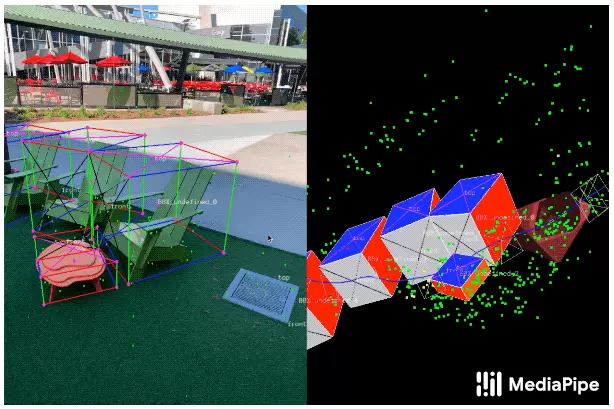

追踪3D物体是一项复杂的工作,特别是当计算资源有限时。当仅有的可用图像为2D时,由于缺乏数据以及物体外观和形状多种多样,这会变得更加困难。

为此,Objectron研发团队开发了一种工具,可以使注释器通过分屏视角显示2D视频帧,来标记物体的3D边界框(即矩形边框)。这些3D边界框将叠加在点云数据、摄像头位置和识别到的平面上。注释器在3D视图中绘制3D边界框后,再通过查看2D视频帧中的投影来验证其位置。而对于静态物体,注释器只需在单个帧中标记目标物体象即可。该工具还使用AR会话数据中的实际摄像头姿态信息,将物体的位置传输到所有帧。

(图片来源:ai.googleblog.com)

为了补充真实世界的数据,以提高AI模型预测的准确性,该团队开发了一个引擎,将虚拟物体放入包含AR会话数据的场景中。这允许使用相机姿态信息、检测到的平面,以及估算的照明,生成物理上可能的、并具有与场景匹配的照明的位置,从而产生高质量的合成数据,其中的渲染物体符合场景的几何形状,并无缝融入真实背景。在验证试验中,合成数据的运用使AI模型预测准确性提高了约10%。

此外,该团队表示,当前版本的Objectron模型足够轻巧,可以在旗舰移动设备上实时运行。借助LG V60 ThinQ,三星Galaxy S20 +和Sony Xperia 1 II等手机中的Adreno 650移动图形芯片,该模型能够每秒处理约26帧。

Objectron在MediaPipe中可用,MediaPipe是一个框架,用于构建跨平台的AI管道,该管道包括快速推理和媒体处理(如视频解码)。提供训练有素的识别鞋子和椅子的模型,以及端到端演示应用程序。

该团队表示,未来计划与研发社区共享其他解决方案,以刺激新的用例、应用和研究工作。此外,该团队打算将Objectron模型进行扩展,以识别更多类别的物体,并进一步提高其在设备中的性能。

相关文章

- 谷歌搜索的人工智能进化包含更多广告

- 谷歌的未来是一个无所不能的搜索框

- Google I/O 2026:Gemini 将成为谷歌年度开发者大会的主角

- 2026智能眼镜“百镜争鸣”,谷歌/阿里/微美全息引领AR/XR产业全面升级

- 谷歌发布 Chromebook 后继产品——Googlebook

- 谷歌称其首次发现并阻止了一个利用AI开发的零日漏洞

- 谷歌首款AI眼镜即将呼之欲出,微美全息(WIMI.US)扎实推进AI+AR生态落地

- 谷歌母公司发布2026年一季度财报,搜索查询量创下历史新高

- 英伟达Rubin芯片落地谷歌A5X实例,多站点集群规模扩展至近百万颗GPU

- Siri悄然接入Gemini大模型,苹果反成谷歌云2026 Next大会主角

- 联合谷歌共建:戴盟发布数百万小时触觉具身数据集

- 谷歌将Marvell纳入双芯片TPU计划,ASIC AI推理格局或将重塑

- 谷歌推出Mac版Gemini人工智能应用

- Meta闭源模型Muse Spark登场,谷歌/微美全息加码投入开源AI“严阵以待”

- 谷歌正式接管母公司Alphabet旗下机器人软件企业Intrinsic

- 谷歌云客户业务负责人重返微软,出任安全主管

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源