探索未来智慧的边界:“纵横”论坛人工智能安全论坛圆满举行

2024-09-11 16:36:31AI云资讯6364

在数字化浪潮的推动下,人工智能(AI)正以其独特的方式重塑世界。然而,随着技术的飞速发展,AI安全问题也日益凸显,成为我们必须面对的挑战。9月10日,作为国家网络安全宣传周的重要组成部分,一场专注于“具身智能安全”的圆桌讨论在“纵横”论坛人工智能安全论坛上隆重举行。本次论坛由国防科技大学电子对抗学院、江淮前沿技术协同创新中心承办,浙江大学计算机科学与技术学院、合肥综合性国家科学中心信息安全研究中心联合承办,安徽华云安科技有限公司协办。本次论坛汇聚了来自全国顶尖高校的教授和行业专家,共同探讨了具身智能的前沿话题,为现场观众带来了一场思想的盛宴。

圆桌讨论:智慧的碰撞

本次论坛由华云安创始人及江淮创新中心研究员沈传宝先生主持。参与讨论的嘉宾包括复旦大学教授张新鹏、武汉大学教授王骞、中国科学技术大学教授张卫明、东南大学教授李松泽,以及深信服技术专家游建舟老师。这些专家学者在AI领域都有着深厚的造诣,他们的见解和讨论为我们提供了宝贵的知识财富。

基本概念:AI的未来形态

在讨论的开始,复旦大学教授张新鹏首先为我们解释了人工智能中的AIGC(人工智能生成内容)、AGI(通用人工智能)以及具身智能的基本概念。张教授指出,随着技术的不断进步,AI正逐渐从单一的任务执行者转变为能够理解、学习和适应复杂环境的智能体。这一转变不仅为AI的发展带来了新的机遇,也带来了新的安全挑战。

安全问题:具身智能的挑战

紧接着,武汉大学教授王骞深入介绍了具身智能的安全问题。王教授强调,具身智能系统在与物理世界互动时,其安全性直接关系到人类的生活和社会的稳定。因此,如何确保这些系统在面对各种潜在威胁时的安全性,是我们必须认真对待的问题。

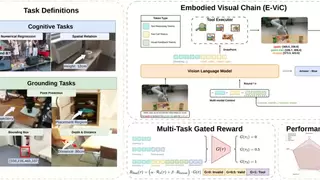

认知安全:智能体的思维保护

中国科学技术大学教授张卫明则从认知安全的角度,探讨了具身智能中的安全问题。张教授提出,认知安全涉及到智能体的决策过程和数据处理方式,我们需要确保智能体在处理信息时的准确性和可靠性,防止错误决策带来的风险。

大模型的缺陷:技术的风险

东南大学教授李松泽则聚焦于具身智能中大模型的缺陷问题。李教授指出,尽管大模型在处理复杂任务时表现出色,但它们也可能存在缺陷和漏洞。因此,我们需要对这些模型进行严格的测试和验证,以确保它们的稳定性和安全性。

互动环节:思想的火花

论坛的最后,主持人沈传宝先生邀请了在场的专家学者和学生们进行了互动。大家就具身智能的安全问题进行了深入的讨论和交流,现场气氛热烈,思想的火花不断碰撞。通过这些互动,我们不仅加深了对具身智能安全问题的理解,也为未来的研究方向提供了新的思路。

结语

随着人工智能技术的不断进步,以及具身智能逐步走向现实。具身智能的安全问题已经成为一个不可忽视的议题。本次纵横论坛的人工智能安全论坛,为我们提供了一个宝贵的平台,让我们能够聆听顶尖专家的见解,共同探讨和应对未来的安全挑战。我们相信,通过不断的研究和合作,我们能够确保人工智能技术的健康发展,让它成为推动社会进步的有力工具。

相关文章

- 地平线获全球首张 ISO 8800 道路车辆人工智能安全认证,树立智能驾驶系统开发全球新标杆

- 恒脑人工智能安全大模型智能体荣获2024年度吴文俊人工智能科技进步奖

- 守护AI安全,共建行业自律典范——科大讯飞签署《人工智能安全承诺》

- 微软宣布举办大型线下黑客大会 为人工智能安全提供高达400万美元奖励

- 加利福尼亚州州长否决了SB 1047人工智能安全法案

- 探索未来智慧的边界:“纵横”论坛人工智能安全论坛圆满举行

- 加利福尼亚州立法机构通过了全面的人工智能安全法案

- OpenAI因反对一项人工智能安全法案而惹非议

- GAITC智能传媒专题|任奎:人工智能安全评测助推大模型健康发展

- 中国信通院联合RealAI发布《人工智能安全框架(2020年)》

- 人工智能安全对抗赛,机器时代的攻与防

- 聚焦世界人工智能安全高端对话:观安信息让大数据更AI更安全

- 2019世界人工智能安全高端对话即将开启

- 宝沃硅谷设美国总部和研发中心 为自动驾驶汽车提供新人工智能安全平台

- CSS2018人工智能安全分论坛:赋能AI,共筑智慧城市新未来

- 2018中国网络安全技术对抗赛在京召开 人工智能安全夺旗赛成焦点

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源