谷歌AI魔镜:看你手舞足蹈,就召唤出8万幅照片学你跳 | TensorFlow.js

2018-07-22 08:38:38AI云资讯1190

前两天,大家还在手机上胡写乱画。

而现在,如果你看到某个同事,对着电脑展现ta婀娜的舞姿。

△失败的“过电”

ta说不定是在扒舞。

有一点点可能,是在玩谷歌发布的又一个AI游戏,名字叫Move Mirror(动镜) 。

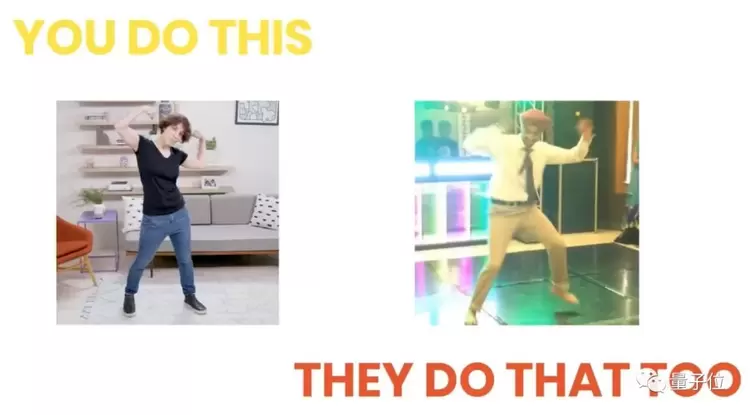

这个游戏里,只要打开摄像头,对着它做你最舒服的动作。

一瞬间,很多人就会“排队”来学着你跳了,一丝不苟,还原神韵。

恭喜你,领取了一呼百应成就。跟你一起跳舞的人,你基本没见过,可能还有从二次元来的朋友。

满足感是否油然而生?

对一个页游来说,这计算量也算是鞠躬尽瘁了。

姿势匹配,一气呵成

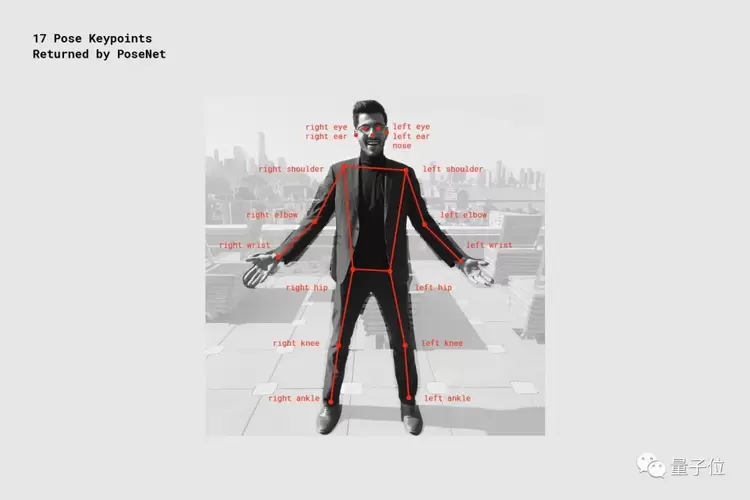

这个游戏里,负责捕捉你姿势的机器学习模型,叫做PoseNet。

看着你愉快地舞动,模型要实时捕捉你的姿势,全程不能松懈。

浑身上下,有17个关键点,每个姿态都是由这些点,共同描写的。

针对每一帧影像,系统都要搜遍80,000张的图库,从茫茫人海里找到姿势差不多的那一位。

这个数据集里,人类的姿态非常丰富,每一张都精挑细选。确实,不可能直接随机取样,每个人的姿势都差不多的话,就没用了。

虽然数据千姿百态,但搜索一次、找到目标,也只要15毫秒而已。

然后,系统迅速用千军万马拼出你的动感,也几乎不用什么时间。

需要的话,还可以把生成效果转成gif,分享到喷油圈——

这似乎是从宅舞向,变成了运动向,AI可能是个偏爱肌肉的妹子。

另外,游戏是用TensorFlow.js做的,不用存储你的影像,也不会把数据传到遥远的服务器里。

和谷歌AI以往的许多页游一样,低碳又安全。

花式PlayPlay

大家不妨一试,看看AI怎么理解你的动作,说不定还能发现一些神匹配。

如果想用TensorFlow.js,自己写一个观察姿势的小应用,可从文底的传送门前往GitHub项目页面,查看代码。

另外,在下比较期待,等哪天游戏里增加了面部动作的识别……

大概就可以更充分地观察,AI对动作的解读方式了。

问题来了,你想用什么姿势来考验它呢?

PlayPlay传送门:

http://g.co/movemirror

GitHub项目传送门:

https://github.com/tensorflow/tfjs-models/tree/master/posenet

DIY指南传送门:

https://medium.com/tensorflow/move-mirror-an-ai-experiment-with-pose-estimation-in-the-browser-using-tensorflow-js-2f7b769f9b23

△仅因姿势销魂而乱入

相关文章

- 谷歌的未来是一个无所不能的搜索框

- Google I/O 2026:Gemini 将成为谷歌年度开发者大会的主角

- 2026智能眼镜“百镜争鸣”,谷歌/阿里/微美全息引领AR/XR产业全面升级

- 谷歌发布 Chromebook 后继产品——Googlebook

- 谷歌称其首次发现并阻止了一个利用AI开发的零日漏洞

- 谷歌首款AI眼镜即将呼之欲出,微美全息(WIMI.US)扎实推进AI+AR生态落地

- 谷歌母公司发布2026年一季度财报,搜索查询量创下历史新高

- 英伟达Rubin芯片落地谷歌A5X实例,多站点集群规模扩展至近百万颗GPU

- Siri悄然接入Gemini大模型,苹果反成谷歌云2026 Next大会主角

- 联合谷歌共建:戴盟发布数百万小时触觉具身数据集

- 谷歌将Marvell纳入双芯片TPU计划,ASIC AI推理格局或将重塑

- 谷歌推出Mac版Gemini人工智能应用

- Meta闭源模型Muse Spark登场,谷歌/微美全息加码投入开源AI“严阵以待”

- 谷歌正式接管母公司Alphabet旗下机器人软件企业Intrinsic

- 谷歌云客户业务负责人重返微软,出任安全主管

- 谷歌年度营收首次突破4000亿美元

人工智能企业

更多>>人工智能硬件

更多>>人工智能产业

更多>>人工智能技术

更多>>- Twinkle x昇腾,率先实现Deepseek-V4系列模型高效训练

- 高德发布鸿蒙首个生成式 UI 开源框架 AGenUI,告别传统 UI 开发模式

- 发布即适配| 天数智芯全力支持腾讯混元Hy3 preview 开源落地,共推国内大模型产业普惠

- Seedance 2.0面向企业公测,豆包大模型日均Token使用量突破120万亿

- 端到端OCR模型第一!百度千帆Qianfan-OCR正式发布

- 云知声Unisound U1-OCR大模型发布!首个工业级文档智能基础大模型,开启OCR 3.0时代

- 基石智算上线 MiniMax M2.5,超强编程与智能体工具调用能力

- 昇腾原生支持,科学多模态大模型Intern-S1-Pro正式发布并开源